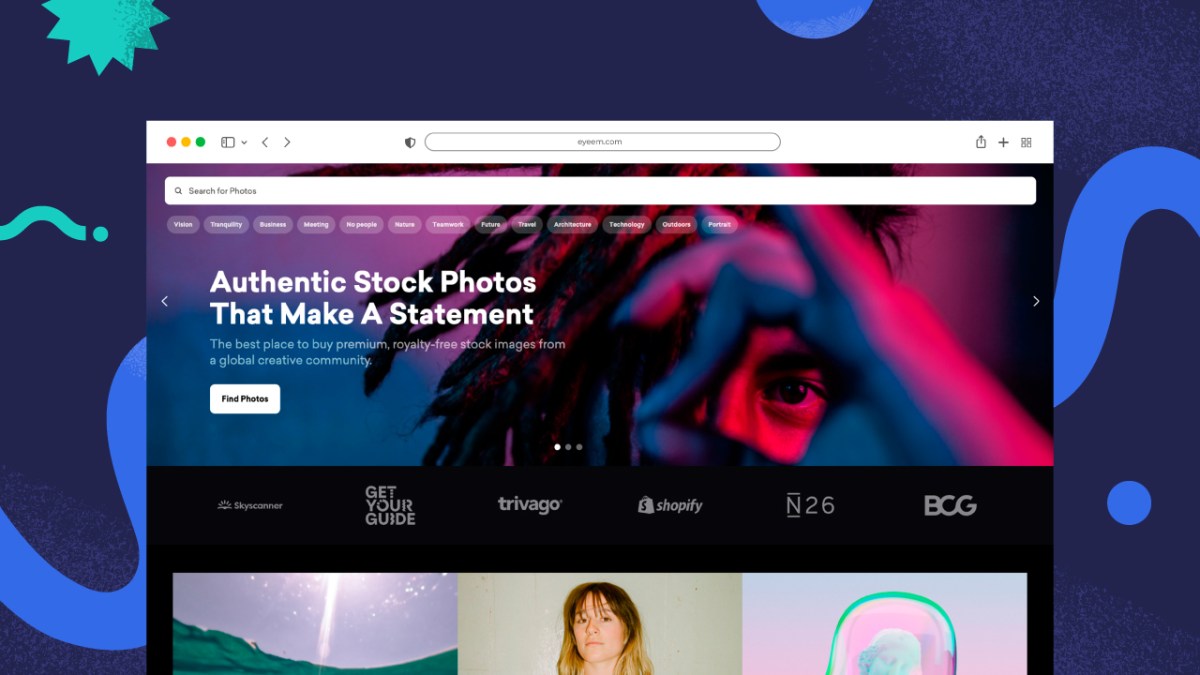

EyeEm, la comunidad berlinesa de intercambio de fotos que salió del mercado el año pasado a la empresa española Freepik después de declararse en bancarrota, ahora está licenciando las fotos de sus usuarios para entrenar modelos de inteligencia artificial. A principios de este mes, la compañía informó a los usuarios por correo electrónico que estaban agregando una nueva cláusula a sus Términos y Condiciones que les otorgaría los derechos para subir el contenido de los usuarios para «entrenar, desarrollar y mejorar el software, algoritmos y modelos de aprendizaje automático». Se les dio a los usuarios 30 días para optar por no participar eliminando todo su contenido de la plataforma de EyeEm. De lo contrario, estaban aceptando este uso para su trabajo.

En el momento de su adquisición en 2023, la biblioteca de fotos de EyeEm incluía 160 millones de imágenes y casi 150,000 usuarios. La empresa dijo que fusionaría su comunidad con la de Freepik con el tiempo. A pesar de su declive, casi 30,000 personas siguen descargándola cada mes, según datos de Appfigures.

En un momento se pensó que EyeEm podría ser un posible competidor de Instagram, o al menos «el Instagram de Europa», pero había disminuido a un personal de tres antes de venderse a Freepik, informó previamente Ingrid Lunden de TechCrunch. Joaquín Cuenca Abela, CEO de Freepik, insinuó los posibles planes de la empresa para EyeEm, diciendo que explorarían cómo incorporar más IA en la plataforma para los creadores.

Resulta que eso significaba vender su trabajo para entrenar modelos de IA.

Ahora, los Términos y Condiciones actualizados de EyeEm dicen lo siguiente:

«8.1 Concesión de Derechos – Comunidad de EyeEm

Al cargar Contenido en la Comunidad de EyeEm, nos otorga respecto a su Contenido el derecho no exclusivo, mundial, transferible y sublicenciable para reproducir, distribuir, mostrar públicamente, transformar, adaptar, hacer obras derivadas, comunicar al público y/o promocionar dicho Contenido.

Esto incluye específicamente el derecho sub-licenciable y transferible para usar su Contenido para la capacitación, desarrollo y mejora de software, algoritmos y modelos de aprendizaje automático. En caso de que no esté de acuerdo con esto, no debe agregar su Contenido a la Comunidad de EyeEm.»

La Sección 13 detalla un proceso complicado para las eliminaciones que comienza con eliminar primero las fotos directamente, lo que no afectaría el contenido que se haya compartido previamente en la Revista de EyeEm o en redes sociales, señala la compañía. Para eliminar el contenido del Mercado de EyeEm (donde los fotógrafos vendían sus fotos) u otras plataformas de contenido, los usuarios tendrían que enviar una solicitud a support@eyeem.com y proporcionar los números de identificación del contenido de esas fotos que querían eliminar y si también debe ser eliminado de su cuenta o solo del mercado de EyeEm.

Es importante destacar que las eliminaciones de EyeEm y las plataformas asociadas podrían tardar hasta 180 días en completarse. Sí, así es: las eliminaciones solicitadas pueden tardar hasta 180 días, pero los usuarios solo tienen 30 días para optar por no participar. Eso significa que la única opción es eliminar manualmente las fotos una por una.

Peor aún, la empresa agrega que:

«Aquíby ncecede y acepta que su autorización para que EyeEm comercialice y otorgue licencias para su Contenido según las secciones 8 y 10 seguirá siendo válida hasta que el Contenido se elimine de EyeEm y todas las plataformas asociadas dentro del plazo indicado anteriormente. Todos los acuerdos de licencia celebrados antes de la completa eliminación y los derechos de uso que se otorgan por ellos no se ven afectados por la solicitud de eliminación o la eliminación.»

La Sección 8 es donde se detallan los derechos de licencia para entrenar IA. En la Sección 10, EyeEm informa a los usuarios que renunciarán a cualquier pago por su trabajo si eliminan su cuenta, lo que los usuarios pueden considerar hacer para evitar que sus datos se utilicen para alimentar modelos de IA. ¡Atrapados!

El movimiento de EyeEm es un ejemplo de cómo se están entrenando modelos de IA sobre la base del contenido de los usuarios, a veces sin su consentimiento explícito. Aunque EyeEm ofreció un procedimiento de exclusión voluntaria de alguna manera, cualquier fotógrafo que no se haya dado cuenta del anuncio habría perdido el derecho de dictar el uso futuro de sus fotos. Dado que la popularidad de EyeEm como alternativa a Instagram había disminuido significativamente a lo largo de los años, muchos fotógrafos podrían haber olvidado que alguna vez lo habían usado en primer lugar. Ciertamente podrían haber pasado por alto el correo electrónico, si no se encontraba en alguna carpeta de spam.

Aquéllos que notaron los cambios se sintieron molestos porque solo se les dio un aviso de 30 días y no tenían opciones para eliminar masivamente sus contribuciones, lo que hacía más doloroso optar por no participar.

Las solicitudes de comentarios enviadas a EyeEm no se confirmaron de inmediato, pero dado que este plazo tenía una fecha límite de 30 días, optamos por publicar antes de recibir una respuesta.

Este tipo de comportamiento deshonesto es la razón por la cual los usuarios hoy están considerando moverse a la web social abierta. La plataforma federada, Pixelfed, que funciona con el mismo protocolo ActivityPub que alimenta Mastodon, está aprovechando la situación de EyeEm para atraer usuarios.

En una publicación en su cuenta oficial, Pixelfed anunció «Nunca usaremos tus imágenes para ayudar a entrenar modelos de IA. Privacidad primero, píxeles para siempre.»