Bienvenidos al intercambio de TechCrunch, un boletín semanal de startups y mercados. Se inspira en la columna diaria TechCrunch+ que lleva su nombre. ¿Quieres recibirlo en tu bandeja de entrada todos los sábados? Regístrate aquí.

La capacidad de la tecnología para reinventar la rueda tiene sus desventajas: puede significar ignorar verdades evidentes que otros ya han aprendido. Pero la buena noticia es que a veces los nuevos fundadores están descubriéndolo por sí mismos más rápido que sus predecesores.

IA, confianza y seguridad

Este año es un año olímpico, un año bisiesto… y también un año electoral. Pero antes de acusarme de parcialidad por Estados Unidos, no solo estoy pensando en la secuela de Biden vs. Trump: Más de 60 países están celebrando elecciones nacionales, por no mencionar las del Parlamento Europeo.

El rumbo de cada una de estas votaciones podría tener un impacto en las empresas tecnológicas; diferentes partidos tienden a tener diferentes enfoques sobre la regulación de la IA, por ejemplo. Pero antes de que tengan lugar las elecciones, la tecnología también tendrá un papel que desempeñar para garantizar su integridad.

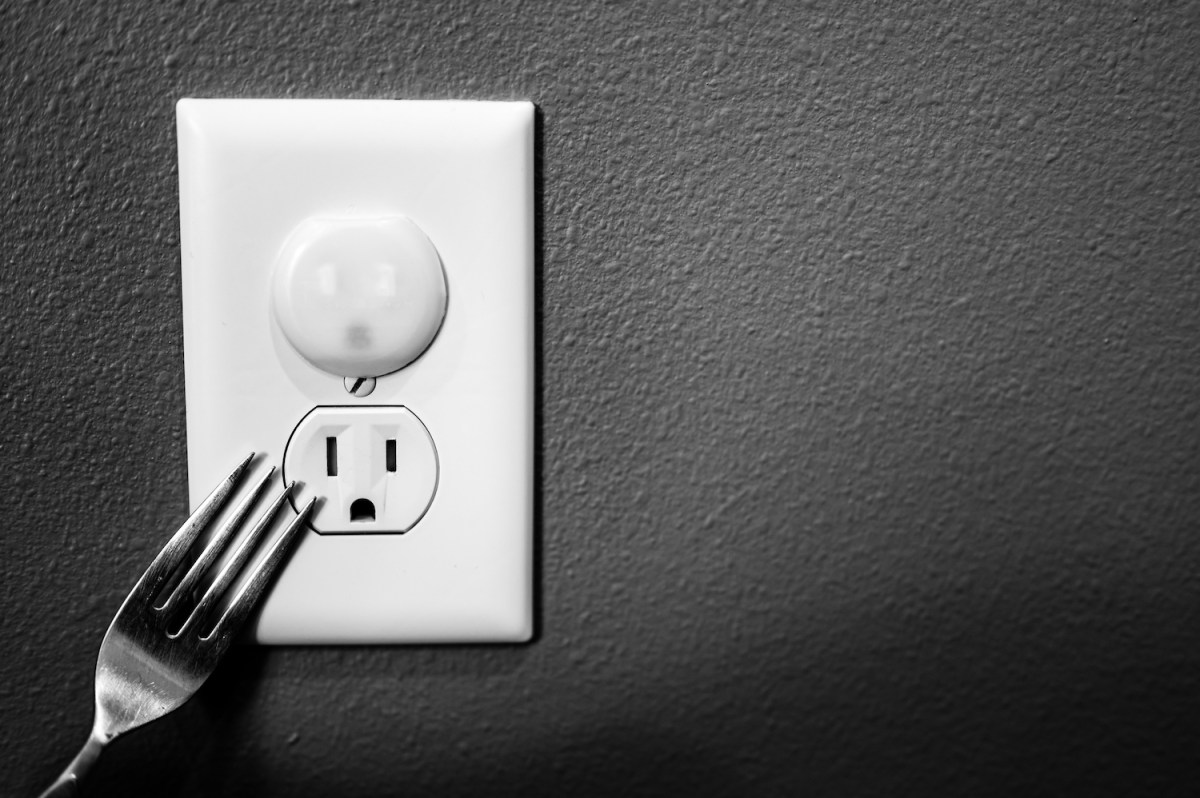

La integridad de las elecciones probablemente no estaba en la mente de Mark Zuckerberg cuando creó Facebook, y tal vez tampoco cuando compró WhatsApp. Pero 20 y 10 años después, respectivamente, la confianza y la seguridad son ahora una responsabilidad que Meta y otros gigantes tecnológicos no pueden evitar, les guste o no. Esto significa trabajar para prevenir la desinformación, el fraude, los discursos de odio, el CSAM (material de abuso sexual infantil), la autolesión y más.

Sin embargo, es probable que la IA dificulte la tarea, no solo por los deepfakes o por empoderar a un mayor número de actores malintencionados. Lotan Levkowitz, socio general de Grove Ventures, dijo: «Todas estas plataformas de confianza y seguridad tienen esta base de datos compartida, por lo que puedo subir allí lo que es malo, compartirlo con todas mis comunidades, y todos juntos lo van a detener; pero hoy, puedo entrenar el modelo para tratar de evitarlo. Así que incluso el trabajo clásico de confianza y seguridad, debido a Gen AI, se está volviendo más y más difícil porque el algoritmo puede ayudar a pasar por alto todas estas cosas».

De una idea posterior a la vanguardia

Aunque los foros en línea ya habían aprendido uno o dos sobre moderación de contenidos, no había un manual de redes sociales que Facebook pudiera seguir cuando nació, por lo que es comprensible que necesitara un tiempo para estar a la altura de la tarea. Pero es descorazonador saber que desde el 2017, en documentos internos de Meta, aún existía reticencia interna a adoptar medidas que podrían proteger mejor a los niños.

Zuckerberg fue uno de los cinco CEO de tecnología de redes sociales que recientemente comparecieron en una audiencia del Senado de los Estados Unidos sobre la seguridad en línea de los niños. Dar testimonio no fue ni mucho menos la primera vez para Meta, pero también es digno de mencionar que Discord fue incluido; aunque ha diversificado sus raíces más allá de los videojuegos, es un recordatorio de que las amenazas a la confianza y seguridad pueden ocurrir en muchos lugares en línea. Esto significa que una aplicación de juegos sociales, por ejemplo, también podría poner a sus usuarios en riesgo de phishing o de preparación.

¿Las empresas nuevas asumirán más rápido que las FAANGs? Eso no está garantizado: los fundadores a menudo operan desde principios básicos, que es bueno y malo; la curva de aprendizaje de la moderación de contenidos es real. Pero OpenAI es mucho más joven que Meta, por lo que es alentador escuchar que está formando un nuevo equipo para estudiar la seguridad infantil, aunque pueda ser resultado del escrutinio al que está sometido.

Sin embargo, algunas startups no esperan a ver signos de problemas para actuar. Un proveedor de soluciones de confianza y seguridad habilitadas para IA y parte de la cartera de Grove Ventures, ActiveFence, está viendo más solicitudes entrantes, según su CEO Noam Schwartz.

«He visto a mucha gente contactar a nuestro equipo desde empresas que acaban de ser fundadas o incluso antes de su lanzamiento. Están pensando en la seguridad de sus productos durante la fase de diseño [y] adoptando un concepto llamado seguridad por diseño. Están integrando medidas de seguridad en sus productos, de la misma manera que hoy estás pensando en la seguridad y la privacidad cuando estás construyendo tus características».

ActiveFence no es la única startup en este espacio, que Wired describió como «confianza y seguridad como servicio». Pero es una de las más grandes, especialmente desde que adquirió Spectrum Labs en septiembre, por lo que es bueno escuchar que sus clientes incluyen no solo grandes nombres temerosos de crisis de relaciones públicas y escrutinio político, sino también equipos más pequeños que recién están comenzando. La tecnología también tiene la oportunidad de aprender de los errores del pasado.