Brasil ha impedido que Meta utilice las publicaciones de los brasileños en Instagram y Facebook para entrenar sus modelos de inteligencia artificial (IA).

Se produce semanas después de que la compañía abandonara planes similares de utilizar las publicaciones de usuarios del Reino Unido y Europa para el mismo propósito.

El martes, la agencia nacional de protección de datos de Brasil (ANPD) dijo que suspendería inmediatamente la última política de privacidad de Meta, que le permite entrenar modelos generativos de IA, como chatbots, basados en publicaciones de sus usuarios.

Un portavoz de Meta dijo a la BBC que la empresa estaba «decepcionada por la decisión» y añadió que su enfoque cumplía con las leyes de privacidad locales.

«Este es un paso atrás para la innovación, la competencia en el desarrollo de la IA y mayores retrasos para llevar los beneficios de la IA a las personas en Brasil», añadió la empresa.

Meta tiene un mercado importante en Brasil. Hay 102 millones de usuarios de Facebook y más de 113 millones de usuarios de Instagram en el país.

La ANPD afirmó que había actuado ante el «riesgo inminente de daño grave e irreparable, o de dificultad para reparar los derechos fundamentales de los titulares [de cuentas] afectados».

Meta recibió cinco días hábiles desde la decisión de la ANPD de demostrar que había modificado su política de privacidad para excluir el uso de información personal encontrada en publicaciones públicas para entrenar IA generativa. Si no cumple, se enfrentará a una multa diaria de 50.000 reales (6.935 libras esterlinas).

La política actualizada de la empresa también fue objeto de escrutinio en el Reino Unido y la Unión Europea (UE).

Según los cambios en su política de privacidad, que debían entrar en vigor en la región el 26 de junio, la información de los usuarios de Meta se utilizaría para «desarrollar y mejorar» sus productos de inteligencia artificial.

En Europa, el cambio de política incluiría publicaciones, imágenes, títulos de imágenes, comentarios e historias que los usuarios mayores de 18 años hayan compartido con una audiencia pública en Facebook e Instagram, pero no mensajes privados.

Pero eso quedó en suspenso después de que Meta dijera que había recibido una solicitud de la Comisión Irlandesa de Protección de Datos (DPC) en nombre de otras partes interesadas europeas para retrasar su capacitación de grandes modelos lingüísticos (LLM).

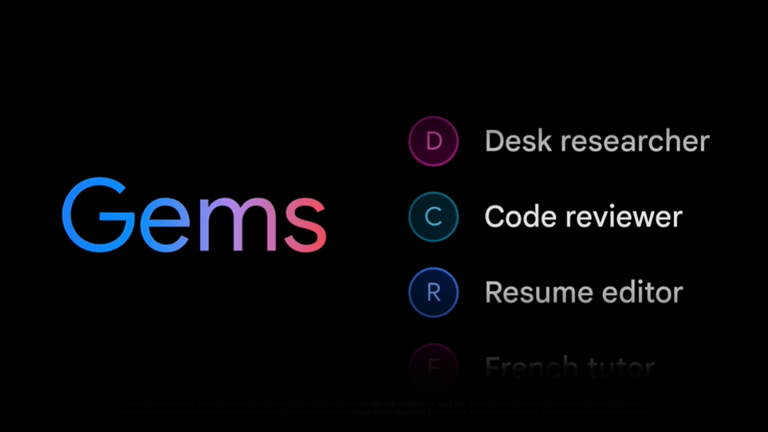

Los LLM son un tipo de inteligencia artificial que impulsa los chatbots, como ChatGPT de OpenAI y Gemini de Google.

El 14 de junio, cuando anunció el retraso, Meta dijo que se trataba de un «paso atrás» para la IA en Europa.

Sin embargo, Meta decidió seguir adelante con el cambio de política en Brasil.

Pedro Martins, de Data Privacy Brasil, saludó la decisión de la ANPD. Le dijo a la BBC que había una discrepancia entre las medidas de protección de datos de Meta para sus usuarios brasileños y europeos.

Meta había planeado utilizar publicaciones de niños y adolescentes brasileños para entrenar sus modelos de IA, dijo, mientras que en Europa nadie menor de 18 años utilizaría sus publicaciones.

El regulador de protección de datos de Brasil también descubrió que los datos personales encontrados en publicaciones de niños y adolescentes podrían recopilarse y utilizarse para entrenar los sistemas de inteligencia artificial de Meta, lo que podría violar la ley de protección de datos del país.

Además, dijo Martins, en Europa los pasos que los usuarios pueden tomar para evitar que Meta use información personal son más sencillos que en Brasil, donde dijo que se pueden tomar hasta ocho pasos para que los usuarios impidan que la compañía use sus publicaciones.

La BBC ha pedido a Meta que responda a la afirmación de que había planeado utilizar publicaciones de niños y adolescentes brasileños para entrenar sus modelos de IA, y si impuso medidas más onerosas para la exclusión voluntaria de los usuarios en Brasil.